5分钟阅读

Gemini 3刷屏之际,Meta 重磅发布 SAM 3 与 SAM 3D:AI 辅助设计再添利器

Gemini 3刷屏之际,Meta 重磅发布 SAM 3 与 SAM 3D:AI 辅助设计再添利器

近期 Google Gemini 3 的发布赚足了眼球,但另一边 Meta 也悄悄放出了两大重磅 AI 模型——SAM 3 与 SAM 3D,前者升级了经典的分割能力并加入多模态支持,后者则实现了单张 2D 图像到 3D 模型的精准重建,为设计、AR/VR、创意内容制作等领域带来全新可能。本文将从设计应用视角,为大家详细解读这两款模型的核心能力、技术亮点与实用价值。

SAM 3:开源抠图模型的多模态进化

作为 Segment Anything 系列的新一代产品,SAM 3 延续了开源特性,在原有强大的目标分割基础上实现了关键升级:支持短文本提示词与示例掩码输入,可跨图像、视频完成目标检测、分割与跟踪,进一步降低了设计中精准选区的操作成本。

Meta 官方对 SAM 3 的定位是:「为开发者和研究者提供创新能力与独特工具,助力创作、实验与媒体工作流升级」。

网友核心反馈

SAM 3 的文本交互能力与跨帧跟踪功能,引发了设计与技术领域用户的广泛讨论:

@HungamaHeadline(11月20日): 「SAM 3D 固然更重磅,但 SAM 3 的升级也很关键——在现有分割功能基础上加入文本提示词(增量创新),而 SAM 3D 能从单张 2D 图像重建完整 3D 几何结构,相当于无需多视角就能达到 NeRF 级别的重建效果,对 AR/VR 内容管线和 3D 资产生成来说意义重大。」

@datarefiner(11月20日):

「即便知道目标分割、3D 合成等底层技术已发展多年,但看到单张 2D 图像直接生成 3D 体积重建的效果,依然觉得像魔法!为 Meta 点赞,内容创作者们值得关注!」

@ilyasiqbal(11月20日): 「太惊艳了!这一代 SAM 模型实现了实质性飞跃:SAM 3 将检测、分割、跟踪整合到单一框架,同时支持短文本提示词和示例掩码,让模型更接近通用多模态感知系统。而 SAM 3D 从单张 2D 图像推断详细 3D 几何结构的能力尤其令人印象深刻——要知道单目重建本身就存在固有的模糊性。」

简明算法解析

- SAM 3 扩展了原始 Segment Anything 架构,采用多任务视觉骨干网络,联合学习目标定位、分割与时间关联;

- 集成轻量级文本编码器实现短语级定位,并通过注意力机制匹配跟踪跨帧目标嵌入;

- SAM 3D 则在此基础上,将 2D 特征投影到预训练 3D latent 空间,利用网格先验和体积推理重建几何结构,通过迭代优化深度与表面一致性,从单张图像生成可信的全身或物体网格。

@ilyasiqbal 还提出了关键疑问:「随着模型向多模态和 3D 领域扩展,Meta 如何解决鲁棒性问题?尤其是遮挡、极端视角、模糊文本提示词等边缘场景,如何确保在真实世界媒体工作流中表现稳定?」

@ImSaranCJ(11月20日):

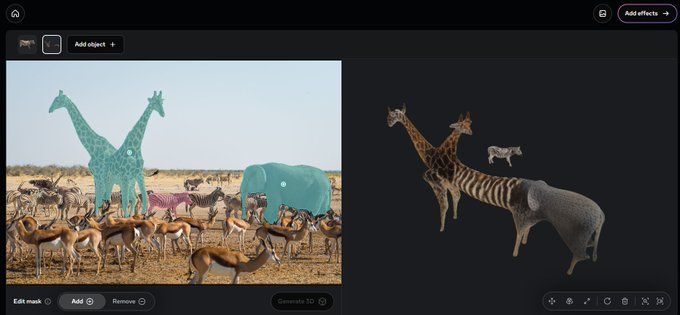

「有意思!能在众多动物中精准提取指定目标~」

SAM 3 模型下载

开源地址:https://huggingface.co/facebook/sam3

SAM 3D:单图生成 3D 模型的设计革命

如果说 SAM 3 是 2D 分割的进化,SAM 3D 则直接开启了「2D 到 3D 一键转换」的新篇章。这款模型分为两大核心版本,彻底改变了设计领域 3D 资产的制作流程。

核心功能与产品亮点

Meta 官方将 SAM 3D 定义为「SAM 系列首款 3D 产品,为自然图像带来常识性 3D 理解能力」,其核心价值包括:

-

两大专项模型

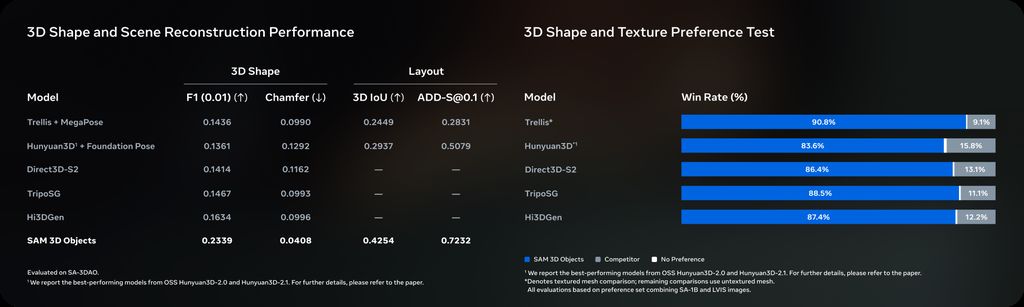

- SAM 3D Objects:专注物体与场景重建,可从日常图像中提取目标物体,生成带纹理、姿态的 3D 模型,支持场景中单个物体的精准操控与多视角查看;

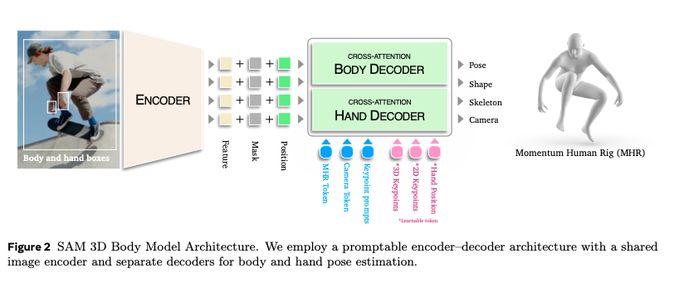

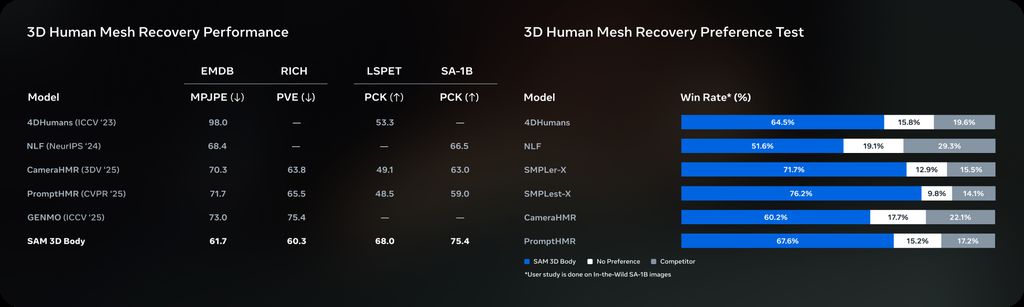

- SAM 3D Body:聚焦人体姿态与形状估计,即便面对特殊姿势、遮挡或多人场景,也能生成精准的 3D 人体网格。

-

全链路开源支持 提供训练/评估数据、基准测试、模型权重、推理代码,以及开源参数化人体模型 MHR(Meta Momentum Human Rig),降低开发者与设计师的使用门槛。

-

交互式体验平台 推出 Segment Anything Playground 在线工具(https://www.aidemos.meta.com/segment-anything),支持上传自定义图像,一键生成 3D 重建结果,无需复杂配置即可体验核心功能。

-

落地场景赋能 已应用于 Facebook Marketplace 的「View in Room」功能,用户可在购买家居用品前,通过 3D 重建预览产品在真实空间中的尺寸与风格适配——这一逻辑同样可迁移至工业设计、室内设计、产品展示等场景。

技术突破:打破 3D 数据瓶颈

传统 3D 重建模型受限于数据规模(3D 标注数据量远低于文本、图像),多依赖合成资产训练,难以适配真实世界场景。SAM 3D 的创新在于:

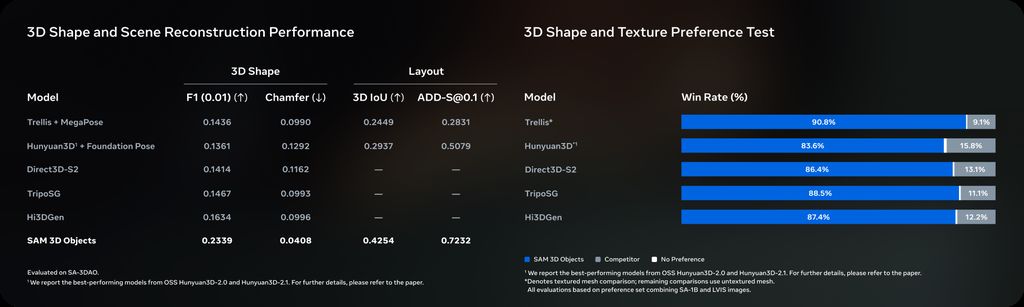

- 数据引擎革新:通过「模型生成候选 + 人工评分 + 专家补全」的闭环,高效标注真实世界图像的 3D 形状、纹理与布局,最终完成近 100 万张图像标注和 314 万个模型生成,突破数据稀缺难题;

- 两阶段训练策略:先通过合成数据预训练,再利用真实世界数据进行后训练,弥合「模拟到真实」的性能鸿沟,形成「数据质量提升 → 模型效果优化 → 数据引擎更高效」的正向循环。

性能与局限

- 优势:在真实世界场景中表现优于现有模型,人体偏好测试中赢率达 5:1 以上;通过扩散捷径等优化,可在几秒内生成高质量带纹理重建结果,支持近实时应用(如机器人 3D 感知);

- 局限:

- 输出分辨率中等,复杂物体细节还原不足(如人体重建可能出现畸变);

- SAM 3D Objects 需逐个处理目标,无法推理物体间物理交互(如接触、遮挡关系);

- SAM 3D Body 暂不支持多人交互与人体-物体互动推理,手部姿态估计精度不及专业模型。

关键资源

- 官方主页:https://ai.meta.com/sam3d/

- SAM 3D Objects 论文:https://ai.meta.com/research/publications/sam-3d-3dfy-anything-in-images/

- SAM 3D Body 论文:https://ai.meta.com/research/publications/sam-3d-body-robust-full-body-human-mesh-recovery/

- 开源仓库:

- SAM 3D Objects:https://github.com/facebookresearch/sam-3d-objects

- SAM 3D Body:https://github.com/facebookresearch/sam-3d-body

- MHR 人体模型:https://github.com/facebookresearch/MHR

写在最后

Meta 此次发布的 SAM 3 与 SAM 3D,本质上是为设计领域提供了「更智能的 2D 选区工具」和「更高效的 3D 资产生成管道」。对设计师而言:

- SAM 3 的文本交互与跨帧跟踪,可大幅简化视频剪辑、动态图形设计中的精准选区操作;

- SAM 3D 的单图 3D 重建能力,让工业设计、室内设计、游戏美术等领域的原型制作效率倍增,无需专业 3D 建模技能即可快速生成基础资产;

- 开源属性与在线 playground 降低了尝试门槛,即便是非技术背景的设计师也能快速上手。

尽管模型仍存在分辨率、交互推理等局限,但 SAM 3 与 SAM 3D 已清晰展现了 AI 辅助设计的核心趋势——将设计师从重复性操作中解放,聚焦创意本身。随着技术迭代,未来 3D 重建精度、多物体交互推理、实时性等问题将逐步解决,AI 与设计的融合也将走向更深层次。

不妨现在就去 Segment Anything Playground 上传一张图像,亲自体验「2D 转 3D」的神奇效果,或许能为你的下一个设计项目带来全新灵感~

更多 AI 前沿技术与设计灵感,欢迎关注「设计小站」公众号(ID:sjxz00),一起探索科技与设计的融合创新。